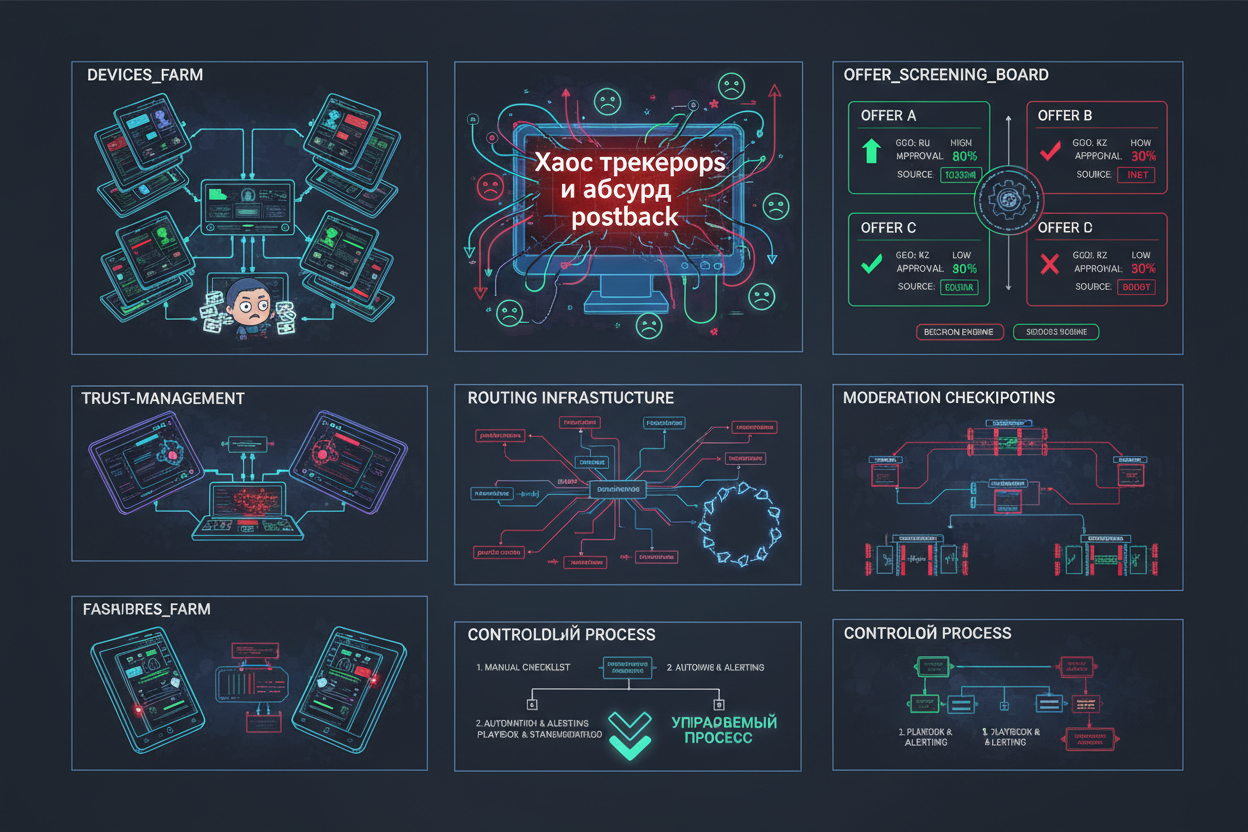

Хаос трекеров и абсурд postback-ошибок: операционная пародия для операторов

Если вы оператор трекера или аналитик, то знаете: postback-ошибки — это не просто баги, а целая операционная драма с элементами абсурда. В этом мемуарном обзоре мы пройдемся по основным симптомам, сравним подходы к диагностике и дадим чеклист для принятия решений, чтобы превратить хаос в управляемый процесс.

Почему postback-ошибки — это не просто технический баг

Постбэк — это нервная система affiliate-операций. Ошибки в нем приводят к потере данных, неверной атрибуции и, как следствие, к финансовым потерям. Но главное — это постоянный стресс для операторов, которые пытаются отладить систему в условиях постоянных изменений офферов и короткого срока жизни связок.

Симптомы операционного хаоса

- Потеря сигналов и непредсказуемые postback-ошибки;

- Несогласованность данных между трекером и рекламными платформами;

- Постоянные тикеты с одинаковыми вопросами и отсутствие единого playbook;

- Выгорание операторов из-за повторяющихся ручных исправлений.

Сравнение подходов к диагностике и устранению postback-ошибок

Существует несколько тактик, каждая со своими плюсами и минусами. Рассмотрим основные.

1. Ручной разбор тикетов и отладка по чеклисту

- Плюсы: детальный контроль, возможность выявить редкие баги;

- Минусы: высокая нагрузка на операторов, медленный процесс, риск человеческой ошибки.

2. Автоматизация мониторинга и алертинг

- Плюсы: быстрое выявление проблем, снижение нагрузки на команду;

- Минусы: требует настройки и поддержки, возможны ложные срабатывания.

3. Внедрение playbook и стандартизация ответов

- Плюсы: ускорение обработки тикетов, повышение качества ответов;

- Минусы: требует постоянного обновления, может не покрывать все кейсы.

Чеклист диагностики postback-ошибок для операторов

| Шаг | Действие | Цель |

|---|---|---|

| 1 | Проверить корректность postback URL и параметры | Исключить ошибки в настройках трекера |

| 2 | Сравнить данные трекера и рекламной платформы | Выявить рассогласования в атрибуции |

| 3 | Проанализировать логи postback-сервера | Определить причины ошибок (тайм-ауты, 4xx/5xx) |

| 4 | Проверить изменения офферов и сроков жизни связок | Учесть внешние факторы, влияющие на postback |

| 5 | Обновить playbook и уведомить команду | Снизить повторяемость ошибок и ускорить реакцию |

Практический мини-кейс: как мемы спасли операционку

В одной из команд, столкнувшись с постоянными postback-ошибками, решили внедрить внутренние мемы и backstage-ритуалы для снижения стресса и повышения вовлеченности. Результат: уменьшение выгорания операторов на 30% и ускорение реакции на тикеты благодаря лучшей коммуникации.

Выводы и рекомендации

- Не пытайтесь бороться с хаосом вручную — автоматизируйте мониторинг и алертинг;

- Создайте и постоянно обновляйте playbook для типовых ошибок postback;

- Используйте командные мемы и ритуалы для поддержания морального духа;

- Регулярно анализируйте влияние изменений офферов и сроков жизни связок на postback;

- Обеспечьте прозрачность и доступность информации для всей команды.

Для глубокой оптимизации операционной инфраструктуры и поддержки команды рекомендуем ознакомиться с нашими услугами по командной операционке и backstage-инфраструктуре.

Полезные ссылки из блога

- Командные мемы и backstage-ритуалы: контр-интуитивный фокус для AI-assisted workflow

- Выгорание креативов как темная комедия: мем-редакционка для фарм-команд

Edge cases и нестандартные сценарии postback-ошибок

В операционной практике встречаются ситуации, которые не укладываются в стандартные чеклисты. Например, частичная потеря данных при нестабильном соединении, когда postback приходит с задержкой или в несколько этапов. Такие кейсы требуют особого внимания к таймингам и логике повторных запросов.

Другой пример — конфликт версий SDK трекера и рекламной платформы, приводящий к несовместимости параметров postback. В таких случаях важно иметь механизм версионирования и обратной совместимости.

Failure modes и anti-patterns в операционной работе с postback

- Игнорирование мелких ошибок: накопление мелких багов без своевременного реагирования ведет к лавинообразному росту проблем.

- Ручное вмешательство без документации: исправления ad-hoc без фиксации в playbook создают «технический долг» и затрудняют передачу знаний.

- Отсутствие rollback-плана: внедрение изменений без возможности быстрого отката увеличивает риски длительных простоев.

QA-проверки и контроль качества postback-инфраструктуры

Рекомендуется внедрять автоматизированные тесты, имитирующие различные сценарии postback, включая негативные кейсы (например, некорректные параметры, тайм-ауты, дублирование). Это позволяет выявлять проблемы до попадания в продакшен.

Регулярные ревью логов и метрик postback-сервера помогают обнаружить аномалии и тренды, указывающие на потенциальные сбои.

Rollback-план и управление рисками при изменениях

Любые обновления в конфигурации трекера или playbook должны сопровождаться четким планом отката. Важно предусмотреть автоматизированные скрипты для возврата к предыдущей стабильной версии и мониторинг состояния после отката.

Handoff-риски и коммуникация между командами

Передача ответственности между операторами, аналитиками и разработчиками часто сопровождается потерей контекста. Для минимизации рисков необходимы стандартизированные отчеты, тикеты с подробным описанием и регулярные синхронизации.

Операционные tradeoffs и баланс между скоростью и качеством

Автоматизация ускоряет реакцию, но может приводить к ложным срабатываниям и пропущенным кейсам. Ручной разбор более точен, но медленен и ресурсоемок. Оптимальная стратегия — комбинировать оба подхода с четким разграничением ролей и зон ответственности.

Прикладные решения для повышения устойчивости операционной инфраструктуры

- Внедрение feature flags для постепенного запуска изменений и быстрого отката.

- Использование централизованного логирования и дашбордов с alert-уведомлениями по ключевым метрикам postback.

- Регулярные обучающие сессии и обмен знаниями внутри команды для снижения зависимости от отдельных экспертов.

- Автоматизация создания тикетов на основе анализа логов и метрик для ускорения реакции.

Практический план внедрения

Чтобы перейти от теории к результату, зафиксируйте целевую метрику и горизонт проверки: конверсия, стоимость лида, скорость обработки, доля ошибок. Для темы «Хаос трекеров и абсурд postback-ошибок: операционная пародия для операторов» важно заранее определить, какой сигнал считается успехом и какой порог запускает корректировку процесса.

Разбейте внедрение на короткие итерации: подготовка данных, ограниченный запуск, валидация гипотез, расширение охвата. На каждом шаге ведите журнал решений и причин отклонений, чтобы команда могла быстро воспроизводить результат и не терять контекст при передаче задач между ролями.

Добавьте операционный чеклист: входные условия, критерии качества, допустимые риски, план отката, ответственные по SLA. Такой формат снижает вероятность «тихих» регрессий и помогает масштабировать процесс без роста ручной нагрузки.

Параллельно настройте мониторинг: отдельные события для бизнес-метрик и технической стабильности. Если метрика улучшается, но растёт латентность или увеличивается доля ошибок, фиксируйте компромисс и корректируйте конфигурацию до балансного режима.

Контроль качества перед масштабированием

- Проверка полноты входных данных и корректности обогащения.

- Сравнение результата с базовой линией до внедрения.

- Аудит edge-case сценариев и правил эскалации.

- Документирование итоговых порогов и регламентов поддержки.

После стабилизации переведите решение в регулярный цикл улучшений: еженедельный разбор аномалий, обновление порогов и пересмотр приоритетов под текущие бизнес-цели. Это позволяет поддерживать предсказуемый рост качества без резких колебаний в продакшене.

Чтобы перейти от теории к результату, зафиксируйте целевую метрику и горизонт проверки: конверсия, стоимость лида, скорость обработки, доля ошибок. Для темы «Хаос трекеров и абсурд postback-ошибок: операционная пародия для операторов» важно заранее определить, какой сигнал считается успехом и какой порог запускает корректировку процесса.

Разбейте внедрение на короткие итерации: подготовка данных, ограниченный запуск, валидация гипотез, расширение охвата. На каждом шаге ведите журнал решений и причин отклонений, чтобы команда могла быстро воспроизводить результат и не терять контекст при передаче задач между ролями.

Добавьте операционный чеклист: входные условия, критерии качества, допустимые риски, план отката, ответственные по SLA. Такой формат снижает вероятность «тихих» регрессий и помогает масштабировать процесс без роста ручной нагрузки.

Параллельно настройте мониторинг: отдельные события для бизнес-метрик и технической стабильности. Если метрика улучшается, но растёт латентность или увеличивается доля ошибок, фиксируйте компромисс и корректируйте конфигурацию до балансного режима.

Контроль качества перед масштабированием

- Проверка полноты входных данных и корректности обогащения.

- Сравнение результата с базовой линией до внедрения.

- Аудит edge-case сценариев и правил эскалации.

- Документирование итоговых порогов и регламентов поддержки.

После стабилизации переведите решение в регулярный цикл улучшений: еженедельный разбор аномалий, обновление порогов и пересмотр приоритетов под текущие бизнес-цели. Это позволяет поддерживать предсказуемый рост качества без резких колебаний в продакшене.

Чтобы перейти от теории к результату, зафиксируйте целевую метрику и горизонт проверки: конверсия, стоимость лида, скорость обработки, доля ошибок. Для темы «Хаос трекеров и абсурд postback-ошибок: операционная пародия для операторов» важно заранее определить, какой сигнал считается успехом и какой порог запускает корректировку процесса.

Разбейте внедрение на короткие итерации: подготовка данных, ограниченный запуск, валидация гипотез, расширение охвата. На каждом шаге ведите журнал решений и причин отклонений, чтобы команда могла быстро воспроизводить результат и не терять контекст при передаче задач между ролями.

Добавьте операционный чеклист: входные условия, критерии качества, допустимые риски, план отката, ответственные по SLA. Такой формат снижает вероятность «тихих» регрессий и помогает масштабировать процесс без роста ручной нагрузки.

Параллельно настройте мониторинг: отдельные события для бизнес-метрик и технической стабильности. Если метрика улучшается, но растёт латентность или увеличивается доля ошибок, фиксируйте компромисс и корректируйте конфигурацию до балансного режима.

Контроль качества перед масштабированием

- Проверка полноты входных данных и корректности обогащения.

- Сравнение результата с базовой линией до внедрения.

- Аудит edge-case сценариев и правил эскалации.

- Документирование итоговых порогов и регламентов поддержки.

После стабилизации переведите решение в регулярный цикл улучшений: еженедельный разбор аномалий, обновление порогов и пересмотр приоритетов под текущие бизнес-цели. Это позволяет поддерживать предсказуемый рост качества без резких колебаний в продакшене.